Le Shadow AI, c'est l'usage non déclaré d'outils d'intelligence artificielle par vos salariés dans un cadre professionnel. 68% d'entre eux l'utilisent sans en informer leur employeur (Microsoft WorkLab, 2025). Ce n'est pas de la désobéissance — c'est une réponse naturelle à un vide de gouvernance. Et ce vide expose votre entreprise à des risques réels, du RGPD à l'AI Act.

Ce que couvre cet article

- Ce qu'est le Shadow AI et pourquoi il explose en 2026

- Qui utilise quoi, dans quels métiers

- Les risques RGPD concrets : fuite de données, responsabilité de l'employeur

- Le lien avec l'AI Act et ses sanctions

- Les 3 niveaux de risque selon l'usage

- Ce que les entreprises qui s'en sortent font différemment

- Comment passer du Shadow AI à une gouvernance IA productive

Qu'est-ce que le Shadow AI ? Définition précise

Le terme "Shadow AI" est l'extension directe du concept de "Shadow IT" — l'usage de logiciels ou services cloud non approuvés par la DSI. Sauf qu'avec l'IA générative, l'ampleur du phénomène est sans commune mesure avec ce qu'on connaissait avant.

Pendant vingt ans, le Shadow IT concernait principalement le stockage de fichiers sur Dropbox personnel ou l'envoi de données via un compte Gmail pro. Des usages localisés, limités, faciles à détecter sur le réseau. Le Shadow AI, lui, touche n'importe quelle conversation, à n'importe quel moment, depuis n'importe quel appareil — y compris le téléphone personnel.

Concrètement, voici ce que font vos salariés sans que vous le sachiez :

- Copier-coller des contrats clients dans ChatGPT pour en extraire les points clés

- Demander à Claude de rédiger des emails de négociation contenant des données commerciales sensibles

- Utiliser Gemini pour analyser des données RH ou des résultats financiers non publiés

- Passer des informations sur des candidats à un recrutement dans un outil IA pour "gagner du temps"

- Résumer des réunions enregistrées — avec des informations confidentielles — via des outils IA non certifiés

Le problème n'est pas l'outil en lui-même. Le problème est que ces données quittent votre environnement maîtrisé pour rejoindre des serveurs tiers, souvent situés hors de l'Union européenne, sans aucun accord de traitement des données (DPA) en bonne et due forme.

Qui utilise l'IA en cachette ? Le profil du Shadow AI user

L'image du salarié qui "triche" avec l'IA est fausse. Dans la grande majorité des cas, il s'agit de collaborateurs performants, proactifs, qui cherchent à gagner du temps sur des tâches répétitives. Ils ne contournent pas les règles par malveillance — ils contournent un vide. Aucune politique claire n'existe, alors ils font au mieux.

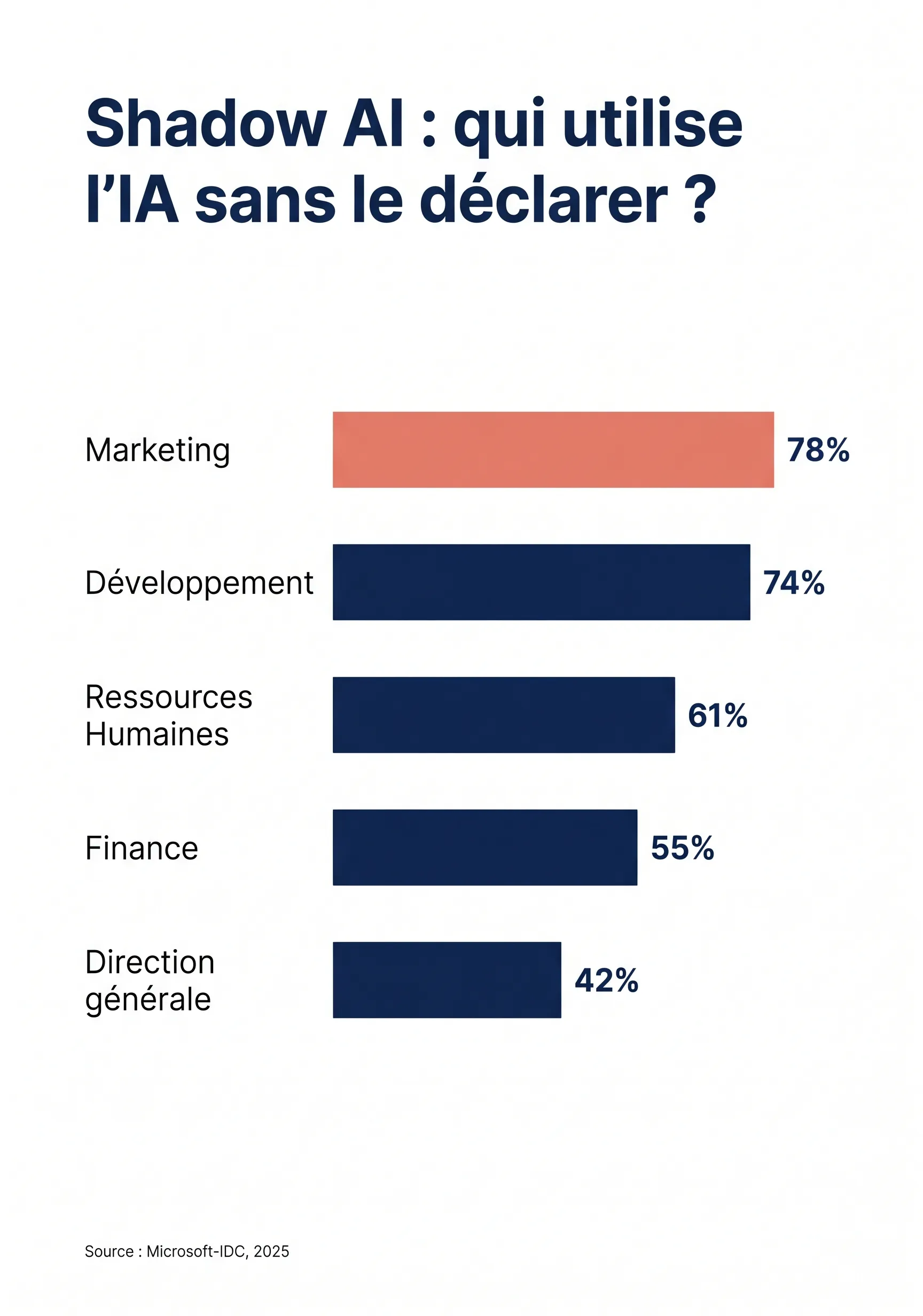

Répartition par métier des salariés déclarant un usage IA non autorisé (Microsoft WorkLab, 2025)

Les métiers les plus touchés sont sans surprise ceux qui manipulent le plus d'information : marketing, développement, RH, finance, direction. 78% des professionnels du marketing déclarent utiliser des outils IA non approuvés au moins une fois par semaine (Microsoft WorkLab, 2025). Dans les équipes de développement, ce chiffre monte à 74% — les développeurs utilisant des assistants de code comme GitHub Copilot ou Claude sans validation formelle de la DSI.

Ce qui est particulièrement révélateur : seuls 32% des salariés qui utilisent l'IA au quotidien le déclarent à leur employeur (Microsoft WorkLab, 2025). Ce n'est pas de la dissimulation active — c'est de l'omission par habitude. L'outil s'intègre dans le flux de travail aussi naturellement que Google, et personne ne pense à signaler chaque recherche Google à son manager.

"Le Shadow AI n'est pas un problème de comportement — c'est un problème de gouvernance. Les salariés utilisent les outils à leur disposition pour faire leur travail. Si les entreprises ne leur fournissent pas de cadre, elles ne peuvent pas s'étonner que ce cadre soit absent."

— Brad Smith, Président de Microsoft, rapport Work Trend Index 2025

Les risques RGPD concrets : ce qui peut vraiment vous arriver

On entend souvent "risque RGPD" comme une formule abstraite. Dans le cas du Shadow AI, les risques sont précis, documentés et déjà arrivés à des entreprises françaises.

La fuite de données personnelles

Lorsqu'un salarié colle un fichier de contacts clients dans ChatGPT pour "nettoyer les données", ces données — noms, emails, numéros de téléphone, parfois données de santé ou financières — transitent sur les serveurs d'OpenAI. Si l'entreprise n'a pas souscrit à la version entreprise d'OpenAI avec un accord de traitement des données (DPA), ces données peuvent être utilisées pour entraîner les modèles futurs. C'est une violation de l'article 28 du RGPD, qui impose un contrat formel entre le responsable de traitement et le sous-traitant.

La CNIL a sanctionné en 2024 une entreprise française pour transfert illicite de données vers un prestataire IA américain, avec une amende de 800 000 euros. Ce n'est pas un cas isolé — en 2025, 34% des violations de données notifiées à la CNIL impliquaient un outil IA tiers non contractualisé (Rapport annuel CNIL 2025).

Le secret professionnel et les données confidentielles

Une avocate qui résume un dossier client dans Claude. Un comptable qui analyse des bilans non publiés avec Gemini. Un RH qui demande à ChatGPT de rédiger un plan de licenciement sur la base de données individuelles. Ces situations créent une double exposition : violation potentielle du secret professionnel et violation des droits des personnes concernées sur leurs données.

En droit français, l'employeur est le responsable de traitement. Quand un salarié envoie des données dans un outil IA non autorisé, c'est l'entreprise qui est responsable de l'infraction, pas le salarié. Ce point est fondamental et souvent mal compris par les directions juridiques.

Le risque de violation de données et la notification obligatoire

L'article 33 du RGPD impose de notifier la CNIL dans les 72 heures lorsqu'une violation de données est découverte. Le problème avec le Shadow AI : vous ne savez pas qu'il y a violation. Vous ne savez pas que votre responsable commercial a copié toute votre base clients dans un outil IA grand public. Quand vous le découvrez — souvent trop tard, souvent suite à un incident ou un audit — le délai de 72 heures est déjà largement dépassé, ce qui constitue une infraction supplémentaire.

Ce que risque concrètement votre entreprise

- Amende CNIL : jusqu'à 20 millions d'euros ou 4% du CA mondial pour violation des obligations RGPD fondamentales

- Notification obligatoire des personnes concernées si les données fuient — avec impact réputationnel direct

- Responsabilité civile vis-à-vis des clients ou partenaires dont les données ont été exposées

- Sous l'AI Act : sanction supplémentaire pour absence de gouvernance IA documentée, dès août 2026

Shadow AI et AI Act : une double exposition réglementaire

La plupart des entreprises ne réalisent pas que le Shadow AI les expose non seulement au RGPD, mais aussi au tout nouveau cadre de l'AI Act européen. Depuis février 2025, l'article 4 de l'AI Act impose une obligation d'AI literacy : les employeurs doivent s'assurer que les salariés qui utilisent ou supervisent des outils IA disposent des compétences nécessaires pour le faire de manière sûre.

Si vos salariés utilisent des outils IA non déclarés, c'est par définition qu'ils n'ont pas été formés dans le cadre d'une politique IA structurée. Vous êtes donc simultanément en infraction RGPD et en infraction AI Act. À partir du 2 août 2026, des sanctions nationales s'appliquent, avec la CNIL et la DGCCRF comme autorités de contrôle désignées en France.

Le paradoxe est réel : l'entreprise qui fait l'autruche face au Shadow AI se retrouve doublement exposée. Celle qui l'affronte avec une politique claire et une formation documentée se met en conformité sur les deux fronts à la fois.

Les 3 niveaux de risque selon l'usage IA

Tous les usages Shadow AI ne sont pas équivalents. Voici une grille de lecture pour prioriser vos actions selon le type de données impliquées et la nature de l'outil utilisé.

| Niveau de risque | Exemples d'usage | Données impliquées | Conséquence principale |

|---|---|---|---|

| Faible | Résumer un article de presse, rédiger un email générique, reformuler un texte sans donnée identifiante | Données publiques ou génériques | Risque RGPD quasi nul. Risque de qualité ou d'hallucination à surveiller. |

| Modéré | Préparer une présentation avec des données internes non personnelles, analyser des tendances marché avec des chiffres d'entreprise agrégés | Données internes non personnelles, chiffres agrégés | Risque de fuite de données stratégiques ou de violation du secret des affaires. À encadrer contractuellement. |

| Critique | Coller une base de contacts clients, analyser des dossiers RH ou de recrutement, résumer un contrat nominatif, traiter des données de santé ou financières | Données personnelles, données sensibles, données confidentielles | Violation RGPD caractérisée, obligation de notification CNIL, risque d'amende, double infraction AI Act. |

La réalité observée sur le terrain : les usages "critiques" représentent environ 41% des cas de Shadow AI documentés dans les entreprises françaises de plus de 50 salariés (Baromètre IA & Conformité, CESIN 2025). Ce n'est pas marginal.

Ce que font les entreprises qui s'en sortent

Certaines organisations ont déjà traversé cette problématique et en tirent aujourd'hui un avantage concurrentiel. Voici ce qui les distingue.

Elles n'ont pas interdit — elles ont encadré

L'interdiction pure et simple de l'IA est contre-productive. Elle pousse les usages encore plus dans l'ombre, dégrade la productivité réelle des équipes, et n'empêche rien puisque les outils sont accessibles depuis les téléphones personnels. Les entreprises les plus avancées ont choisi la voie inverse : légaliser et structurer l'usage.

Selon le Baromètre Microsoft-IDC 2025, les entreprises qui ont mis en place une politique IA formelle et formé leurs équipes ont réduit de 73% les incidents liés au Shadow AI en moins de six mois. Pas en interdisant — en rendant l'usage encadré plus simple et plus efficace que l'usage clandestin.

Elles ont fait un audit interne honnête

La première étape est toujours la plus difficile : admettre qu'il se passe quelque chose qu'on ne contrôle pas. Un audit interne simple — une enquête anonyme auprès des équipes — permet de cartographier les outils utilisés, les types de données impliquées, et les cas d'usage réels. Sans jugement, sans sanction, juste pour comprendre.

La surprise est souvent à la hauteur de l'enjeu. Dans 80% des cas, les directions découvrent que des outils IA sont utilisés dans au moins 3 métiers qu'elles n'avaient pas identifiés (Étude Gartner, 2025).

Elles ont investi dans la formation avant la réglementation

Former les équipes à l'IA n'est pas seulement une obligation légale — c'est le seul moyen de créer une culture dans laquelle les salariés savent spontanément ce qui est autorisé et ce qui ne l'est pas. Une formation bien conçue remplace une politique d'interdiction par une politique de compétence.

Les entreprises qui ont formé leurs équipes avant la mise en conformité AI Act ont en moyenne 2,4 fois moins d'incidents de conformité que celles qui ont attendu la réglementation pour agir (KPMG, Rapport IA & Gouvernance, 2025).

Sans cadre vs Avec cadre : la différence concrète

Voici ce que change réellement le passage d'un Shadow AI non géré à une politique IA structurée, pour les dimensions qui comptent dans votre quotidien de dirigeant.

| Critère | ❌ Sans cadre IA | ✅ Avec politique + formation |

|---|---|---|

| Conformité RGPD | Exposition permanente — vous ne savez pas quelles données partent où | Outils approuvés avec DPA signés, traitements documentés |

| Conformité AI Act | Infraction potentielle dès août 2026 — absence de preuve de formation | AI literacy documentée, attestations de formation disponibles pour contrôle |

| Risque de fuite de données | Non maîtrisé — données clients, contrats, données RH exposés | Limité aux outils approuvés, avec paramétrage "ne pas entraîner les modèles" |

| Productivité réelle | Gains individuels non mesurés, non reproductibles, non partagés entre équipes | Gains mesurés, bonnes pratiques diffusées, ROI calculable |

| Responsabilité en cas d'incident | Entière sur l'employeur — l'absence de politique aggrave la faute | Partagée — la politique + formation documentée atténue la responsabilité |

| Engagement des équipes | Frustration des early adopters IA, sentiment de devoir "se cacher" | Les meilleurs utilisateurs deviennent des relais internes (IA Champions) |

3 étapes concrètes pour passer du Shadow AI à une gouvernance IA productive

Cartographier les usages existants — sans punir

Lancez une enquête interne anonyme de 5 minutes. Questions clés : quels outils IA utilisez-vous ? À quelle fréquence ? Sur quels types de tâches ? Quel type de données y entrez-vous ? Les résultats vous donnent une photographie précise du Shadow AI réel dans votre organisation. Ne cherchez pas à identifier les personnes — cherchez à comprendre les patterns.

Définir une politique IA claire en 3 catégories

Outils verts (approuvés sans restriction : ex. ChatGPT Entreprise avec DPA, Microsoft Copilot via votre tenant Azure). Outils orange (approuvés pour certains usages uniquement : ex. Claude API pour tâches non confidentielles). Outils rouges (interdits pour données professionnelles : ex. tout outil grand public sans DPA signé). Publiez cette liste et expliquez le raisonnement — les équipes adhèrent mieux quand elles comprennent pourquoi.

Former les équipes pour rendre l'usage encadré plus attrayant

Une politique sans formation ne change rien. L'objectif est que chaque salarié sache utiliser les outils approuvés mieux qu'il n'utilisait les outils clandestins. Cela passe par une formation pratique, orientée métier, qui montre concrètement comment utiliser l'IA de manière productive et conforme. Cette formation satisfait par la même occasion l'obligation d'AI literacy de l'AI Act — deux problèmes résolus en une action.

Le bon ordre de priorité

Ne commencez pas par la politique — commencez par la cartographie. Une politique rédigée sans connaître les usages réels sera contournée dès le premier jour. La séquence audit → politique → formation est la seule qui tient dans la durée.

Le Shadow AI comme opportunité : changer de perspective

Il y a une lecture positive que peu de directions osent formuler : le Shadow AI est la preuve que vos équipes veulent être productives. Elles ont trouvé des outils qui les aident et les ont adoptés spontanément. C'est une forme d'innovation bottom-up remarquable.

Les entreprises les plus avancées sur l'IA en 2026 ne sont pas celles qui ont eu les meilleures stratégies top-down. Ce sont celles qui ont su identifier leurs "Shadow AI champions" — les salariés qui utilisaient l'IA de manière avancée avant tout le monde — et les ont intégrés comme relais internes de la transformation. Ces personnes connaissent les vrais cas d'usage, les vraies frictions, et la vraie valeur que l'IA apporte dans leur métier.

Une étude McKinsey publiée en 2025 montre que les entreprises qui ont identifié et formalisé le rôle d'"IA Champion" interne ont déployé leurs politiques IA 3,2 fois plus vite que celles qui ont géré la transformation de manière exclusivement descendante. Le Shadow AI, bien géré, est donc un actif — pas un problème.

Ce que vous devez faire cette semaine

Si vous êtes dirigeant ou responsable RH et que vous lisez cet article, vous avez probablement déjà une intuition : il se passe quelque chose dans vos équipes avec l'IA, et vous n'avez pas encore le cadre pour le gérer. Voici les actions concrètes à engager dans les sept prochains jours.

Jour 1-2 : Vérifiez si votre entreprise dispose d'une politique IA écrite. Si non, notez-le formellement comme un risque de conformité à traiter en priorité avant le 2 août 2026.

Jour 3-4 : Identifiez les outils IA déjà en usage dans l'entreprise — via une discussion avec la DSI et les responsables de département. Pas besoin d'une enquête formelle pour commencer : une conversation avec 5 managers vous donnera déjà 80% de l'image réelle.

Jour 5-7 : Planifiez une session de formation IA pour vos équipes. Cette formation doit être certifiée Qualiopi pour être finançable via votre OPCO, et doit couvrir à la fois les bonnes pratiques d'usage et les enjeux de conformité. C'est précisément ce que Nerolia Formation propose — des formations métier concrètes, certifiées, finançables.

Le coût d'une formation IA pour vos équipes est sans commune mesure avec le coût d'une sanction CNIL, d'une violation de données notifiée à vos clients, ou d'une mise en demeure de la DGCCRF au titre de l'AI Act. La question n'est plus "est-ce que je dois former mes équipes ?" — c'est "est-ce que je peux me permettre de ne pas le faire ?"

Nerolia Formation vous accompagne

Nos formations IA en entreprise sont certifiées Qualiopi (N° QUA009366), finançables via OPCO, et conçues pour être directement opérationnelles. Chaque formation inclut un module conformité IA qui couvre les obligations RGPD et AI Act. Nous pouvons intervenir en intra-entreprise, en distanciel ou en présentiel à Paris et dans toute la France.

FAQ — Shadow AI en entreprise

Qu'est-ce que le Shadow AI en entreprise ?

Le Shadow AI désigne l'usage non déclaré d'outils d'intelligence artificielle par des salariés dans un cadre professionnel, sans validation ni encadrement de la direction ou de la DSI. Il inclut l'usage de ChatGPT, Claude, Gemini ou tout autre outil IA public pour traiter des données ou des tâches professionnelles, en dehors de toute politique interne.

Le Shadow AI est-il illégal pour le salarié ?

Le salarié n'est généralement pas en infraction pénale. En revanche, si cet usage entraîne une violation de données confidentielles ou personnelles, sa responsabilité peut être engagée. L'employeur reste le premier responsable au regard du RGPD — c'est lui le responsable de traitement.

Quels sont les risques RGPD concrets du Shadow AI ?

Lorsqu'un salarié colle des données clients ou des informations confidentielles dans un outil IA public, ces données peuvent être stockées sur des serveurs hors UE ou utilisées pour entraîner les modèles. Cela constitue une violation du RGPD, avec obligation de notification CNIL sous 72 heures et risque d'amende jusqu'à 4% du CA mondial.

Comment encadrer le Shadow AI efficacement ?

En trois étapes : cartographier les usages existants via un audit interne anonyme, définir une politique IA claire (outils autorisés / à usage limité / interdits), puis former les équipes pour que l'usage encadré soit plus simple et plus efficace que l'usage clandestin. L'interdiction seule ne fonctionne pas.

La formation IA pour encadrer le Shadow AI est-elle finançable par l'OPCO ?

Oui. Les formations IA certifiées Qualiopi, comme celles de Nerolia Formation (N° QUA009366), sont éligibles au financement OPCO dans le cadre du plan de développement des compétences. L'obligation d'AI literacy imposée par l'AI Act depuis février 2025 renforce encore la légitimité de ces financements.